클라우드 형태 AI랑 로컬AI 쓰고 있는 도탁서인데요.

결론부터 이야기하면

이 글을 한 줄로 이야기하면

'앞으로 메모리 수요가 더 늘어날 거 같아요.'

로컬AI 비유를 들자면 작년 120b모델이 올해 9b모델보다 성능이 비슷해지는 경우지고 있습니다.

최근에 LLM모델들이 메모리 최대한 적게 먹으면서 성능이 좋게 만드는 최적화 작업방향으로 개발되고 있어요.

그럴 수 밖에 없는게 메모리 비용이 비싼 이유도 있는데

피지컬AI로 가려면 결국에는 경량화 작업이 필연적이기 때문이죠.

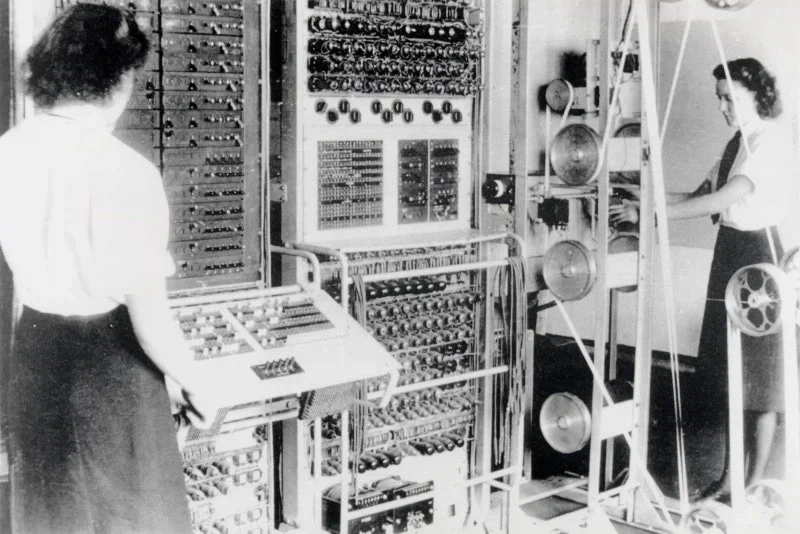

과거 초기 컴퓨터가

이렇게 컸는데

지금은

이 작은PC로 문서작업과 게임과 디자인 작업까지 가능해졌죠.

AI모델들이 딱 이런 방향으로 갈 거 같고

메모리 부분은

지금과 같은 기업과 기업간 거래에서

기업과 소비자 거래로 전환되어서 시장이 변화 될 거 같아요.

경량화가 된다는 건 로컬AI로 서버급 성능으로 간다는 건데

스마트폰, 노트북, 자동차, 휴먼로이드 로봇, 생활가전 등 많은 곳에 적용 될 거고

이미 구글에서 gemma4라는 걸 로컬ai모델을 공개해서

스마트폰에서도 에이전틱한 로컬ai 돌릴 수 있게 e2b모델 출시했고.

거기에 더해서 전성비 좋게 하려고 최근에는 MTP기술을 공개하기도 했는데요

MTP는 대충 차로 따지면 기본엔진에 터보를 붙인 거라고 생각하면됩니다.

결과적으로 메모리 산업은 계속해서 호황이 올 수 밖에 없어요.

NPU나 자체 ai 돌릴 수 있는 칩개발 한다곤 하지만 결국 메모리 칩은 필요합니다.

한식에 김치가 빠지지 않는 이유랑 같죠.

인스티즈앱

인스티즈앱