인간과 인공 지능(AI)이 소비하는 전력의 비교. 2018년 12월에 국제 학회 IEDM 2018의 튜토리얼 강연인 Emerging Device Technologies for Neuromorphic Computing에서 CNRS의 Damien Querlioz가 공개한 슬라이드.

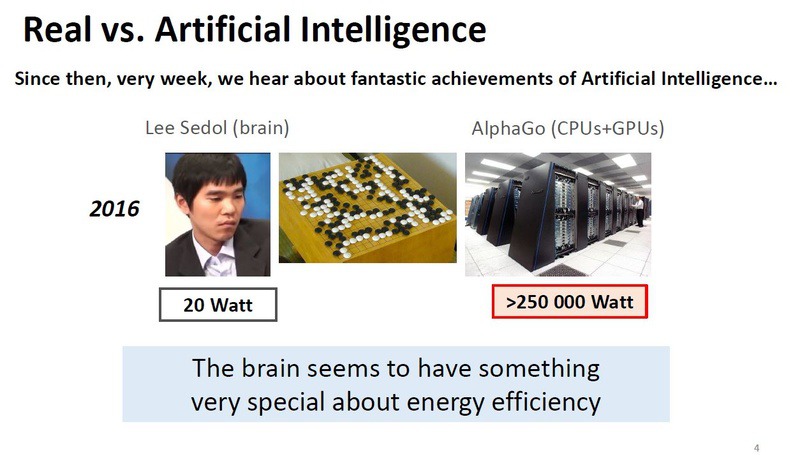

딥 러닝 기술이 인공 지능 (AI)과 머신 러닝의 비약적인 발전을 촉구하면서, 현재 컴퓨터 분야의 연구 개발자들에게 몹시 중요한 주제로 자리잡아가고 있습니다. 구글의 자회사인 딥마인드가 개발한 바둑 프로그램, 알파고가 2016~2017년에 바둑 프로 기사들을 상대로 승리를 거두면서, 딥 러닝의 개발 성과가 평범한 사람들과 AI 연구 개발자들에게 충격을 주었습니다.

가장 충격적이었던 건 2016년 3월의 대결입니다. 세계 최고 수준의 바둑 프로 기사인 이세돌과 알파고의 5회 대전에서 알파고가 4승 1패로 승리를 거두었습니다. 대국 전에는 바둑이나 컴퓨터 업계 모두 이세돌이 5전 모두 이기리라 예측했었지요.

바둑이란 게임의 실력으로는 컴퓨터가 인간을 넘어섰지만, 공학적으로 보면 알파고가 여전히 뒤쳐진 부분이 있습니다. 그건 소비 전력입니다. 알파고의 하드웨어는 다양한 CPU, GPU, ASIC로 구성되며, 2016년 3월의 경기에선 클라우드 컴퓨팅을 사용했습니다. 그 소비 전력은 250kW(25만 와트)를 넘어섰습니다. 이에 비해 인간의 뇌가 쓰는 전력은 20W에 불과합니다. 둘 사이에는 1만 배 이상의 차이가 있습니다.

딥 러닝 하드웨어가 많은 전력을 소비하는 이유

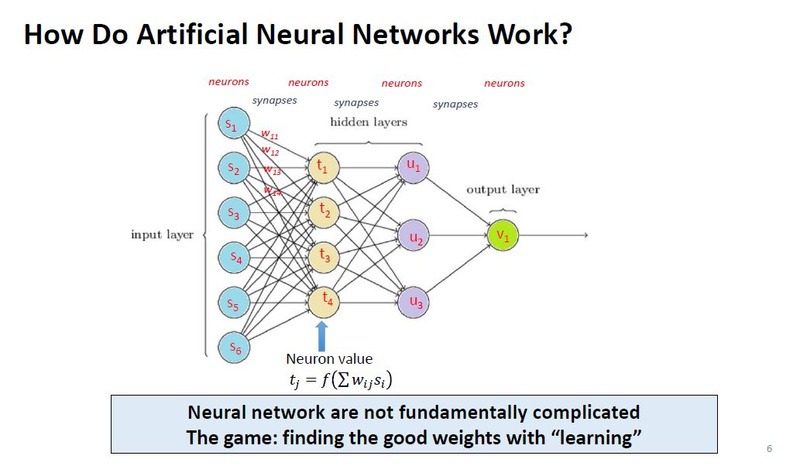

딥 러닝의 기본 구조는 신경 회로망의 모방입니다. '인공 신경망'에 해당되지만 AI 업계에선 그냥 '신경망'이라고 부릅니다. 딥 러닝의 신경망은 DNN(Deep Neural Network)이라 부릅니다. 신경망은 뉴런의 각 층이 서로 연결된 네트워크입니다. 이 중에서 사이에 숨겨진 층이 2개 이상인 네트워크를 DNN이라고 부릅니다.DNN의 입력 층은 입력 데이터를 저장한 뉴런의 연결이며, 하나의 뉴런은 다음 층인 딥 레이어 뉴런과 연결됩니다. 여기서 중요한 건 가중치라 불리는 데이터로, 신경망에서는 시냅스라고 부릅니다. 뉴런 사이의 연결 부위에 해당됩니다. 숨겨진 레이어 뉴런과 연결된 입력 층 뉴런의 값과 가중치 값을 곱하고, 그 모든 결과를 더해 특정 활성화 함수에 입력해 출력합니다.

이 알고리즘은 수학적으로 보면 그리 복잡하지 않습니다. MAC(Multiply and ACcumulation)과 그 결과의 활성화 함수 연산을 반복하는 과정입니다. 여기서 중요한 건 DNN의 출력 계층 데이터(학습이나 추론의 결과)를 결정하는 게 '가중치' 값이라는 겁니다. 즉 DNN을 사용한 학습은 가중치를 조정해 최적의 값을 도출해 내는 과정입니다. '학습'은 신경망의 출력 값과 예상 출력 값을 비교해 그 차이가 줄어들 때까지 각 층의 가중치 값을 업데이트합니다. 차이가 가장 줄어들었을 때 교육을 끝내고, 그렇게 얻은 가중치 값을 DNN을 사용한 추론에 사용합니다.

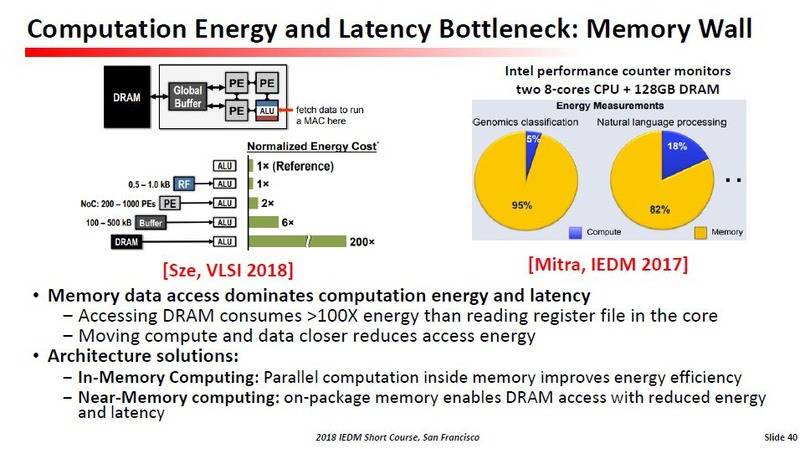

DNN의 일반적인 하드웨어는 CPU, GPU, ASIC 등의 연산 회로와 버퍼 SRAM, 외부 DRAM 등 메모리 회로로 구성됩니다. 이런 구성의 하드웨어가 큰 전력을 사용하는 이유는 크게 두 가지입니다. 하나는 외부 DRAM에 액세스가 많다는 겁니다. DRAM에 가중치 값을 저장하고 불러오기에 DRAM의 액세스는 항상 발생합니다. DRAM 액세스는 CPU 레지스터 액세스보다 100배 더 많은 전력을 사용합니다.

다른 하나는 CPU와 GPU의 정밀도가 너무 높아서입니다. CPU와 GPU는 64비트 부동소수점 연산을 실행하지만, 딥 러닝은 8비트 정수 연산만으로 충분한 경우가 많습니다.

비휘발성 메모리 기술로 딥 러닝의 소비 전력을 낮추는 시도

그래서 소비 전력을 낮추기 위해 메모리 회로에 연산 기능을 통합하고, 메모리 회로와 연산 회로 사이의 거리를 줄이며, 연산 정밀도를 실용적인 범위 안에서 낮추려는 연구가 진행 중입니다.

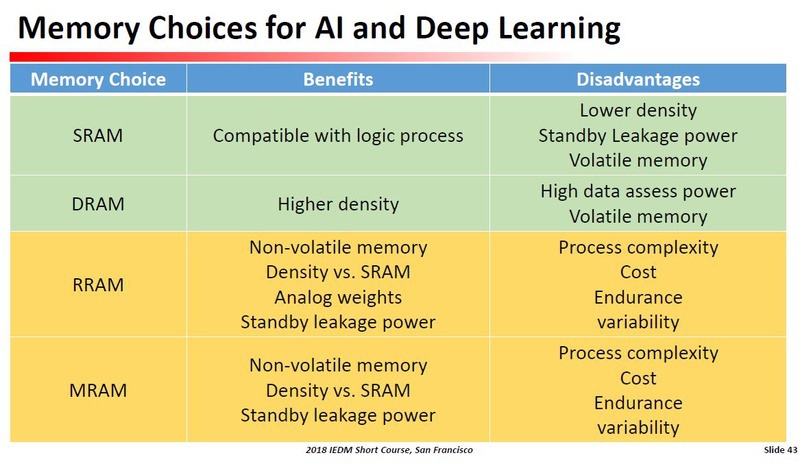

버퍼 메모리인 SRAM와 외부의 DRAM은 모두 휘발성 메모리며, 데이터를 유지하기 위해 리프레시 동작을 주기적으로 실행하면서 평균 소비 전력이 늘어납니다. 이걸 비휘발성 메모리로 대체하면 이론적으로 대기 상태에서 소비 전력이 0으로 떨어집니다. 그럼 평균 소비 전력이 줄어들겠지요. 또 전원을 꺼도 비휘발성 메모리에 데이터가 남아 있으니 기동과 리셋 등의 동작에 필요한 전력도 줄어듭니다.

딥 러닝에서 각종 메모리 기술의 장점과 단점. Embedded Memory ~ Present status, architecture and technology for emerging applications에서 TSMC의 Eric Wang이 공개한 슬라이드.

5월이 미국 캘리포니아 몬타 레이에서 열린 반도체 메모리 기술 국제 학회인 2019 IEEE 11th International Memory Workshop(IMW 2019))에서 비휘발성 메모리 기술로 저전력 딥 러닝 하드웨어를 실현하려는 연구 성과가 다수 공개됐습니다. 여기에서 발표된 비휘발성 메모리 기술은 저항 변화 메모리(ReRAM), 상변화 메모리 (PCM), 자기 저항 메모리(MRAM), 플래시 메모리입니다. 그리고 AI 하드웨어 아키텍처는 신경망 컴퓨팅 외에도 뉴로몰픽(생체신경모방) 컴퓨팅을 사용합니다.

신경 회로망을 물리적으로 모방하는 뉴로몰픽 컴퓨팅

신경망 컴퓨팅은 신경 회로망의 기능과 구조를 모방하지만 하드웨어는 신경 회로망을 모방하지 않습니다. 극단적으로 말하면 신경망을 이용한 학습과 추론은 일반적인 컴퓨터 하드웨어 플랫폼과 응용 프로그램 중 하나일 뿐입니다. 그러나 보통의 컴퓨터 하드웨어에 비해 전력 효율이 너무 낮기에, GPU나 ASIC를 써서 전력 효율을 높이는 게 최근의 움직임입니다. 그 연장선상에 비휘발성 메모리 기술을 이용하려는 시도가 있습니다.이에비해 뉴로몰픽 컴퓨팅은 하드웨어 자체가 신경 회로망을 구축합니다. 기본 요소는 뉴런과 시냅스입니다. 뉴런은 비선형 처리를 담당하고, CMOS 디지털 연산 회로나 아날로그 연산 회로로 실현합니다. 시냅스는 인접한 뉴런 사이의 결합 강도 (가중치)을 담당하고, 결합의 강도를 아날로그나 디지털 메모리에 저장합니다.

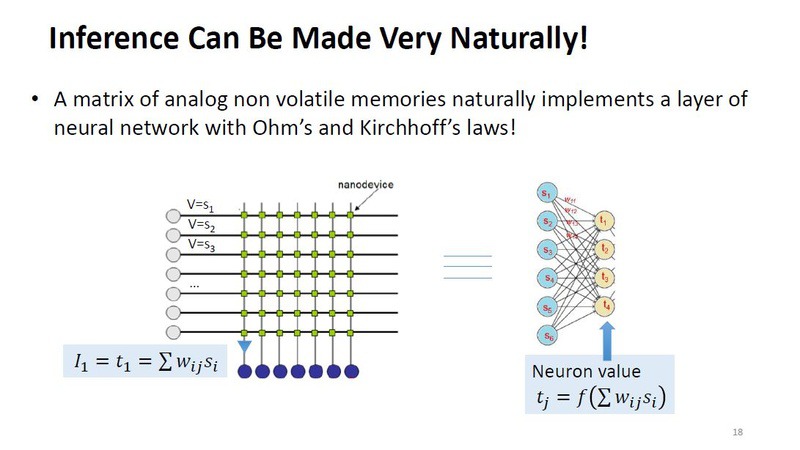

뉴로몰픽 컴퓨팅의 메모리 칩은 신경 회로망과 유사한 행렬(매트릭스) 형태로 메모리 셀 어레이를 배치한 구조를 채용하며, 옴의 법칙과 키르히호프 법칙을 이용한 덧셈 연산을 내장한 경우가 많습니다. 외형 구조는 신경망과 크게 다르지 ㅇ낳습니다.

시냅스의 역할을 하는 메모리 기술은 SRAM과 비휘발성 메모리가 있습니다. SRAM은 CMOS 로직과 같은 제조 기술로 만들 수 있다는 장점이 있습니다. 비휘발성 메모리는 SRAM보다 저장 밀도가 높고 소비 전력이 낮습니다.

ReRAM 기반으로 2백만개의 시냅스를 내장한 저전력 메모리

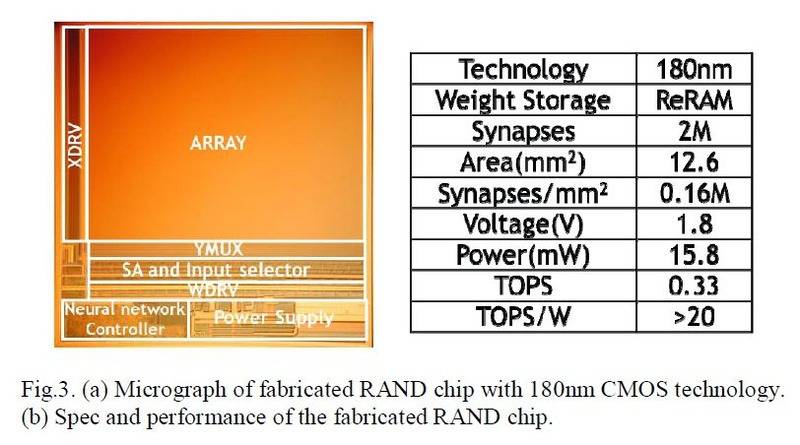

IMW 2019에서 파나소닉은 저항 변화 메모리(ReRAM) 기술을 기반으로 삼은 아날로그 메모리를 시냅스로 쓰고, MAC 연산을 내장한 뉴로몰픽 메모리를 개발해 RAND (Resistive Analog Neuromorphic Device)라고 불렀습니다. 2개의 ReRAM 셀에 1개의 시냅스를 구성하고, 2백만 개의 시냅스를 내장한 실리콘 다이를 180nm의 제조 기술로 만들었습니다. 실리콘 다이 면적은 12.6제곱mm, 전원 전압은 1.8V, 소비 전력은 15.8mW입니다. 소비 전력 당 연산 성능은 20.7TOPS/W로 꽤 높습니다.

PCM의 비선형성을 없애고 합습 정밀도를 향상

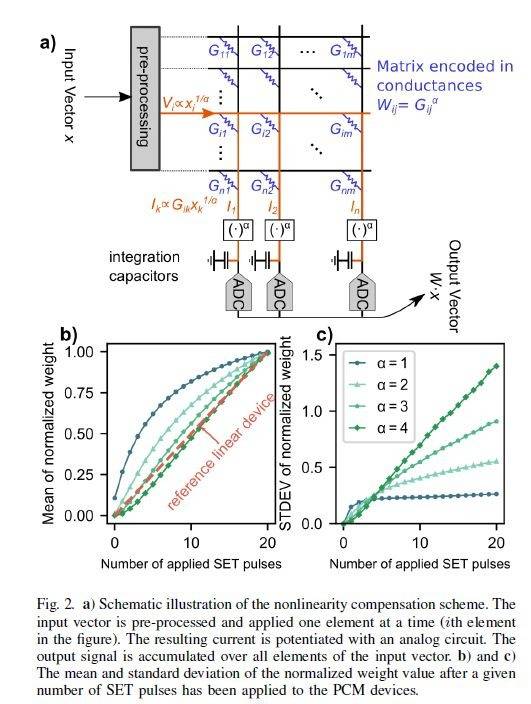

IBM Research와 ETH Zurich는 상변화 메모리 (PCM)을 DNN 가중치 메모리로 사용하는 딥 러닝 가속을 공동 개발합니다. 크로스바 형태로 배치한 PCM 셀 어레이에 가중치 값을 저장하기 전과 저장한 후에 특정 작업을 추가하면 PCM의 비선형성을 없앨 수 있다는 기술을 발표했습니다. 이로서 필기 인식 학습의 정밀도를 높일 수 있다고 합니다.

64Gbit의 3D 낸드 플래시에서 연속 읽기 내구성을 확인

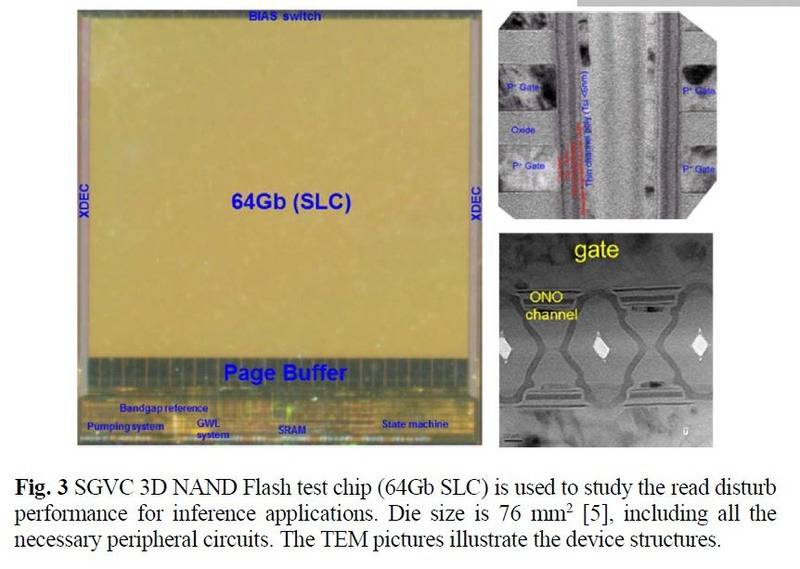

저장 밀도가 가장 높은 비휘발성 메모리는 3D 낸드 플래시 메모리입니다. 3D 낸드 플래시 메모리는 싱글 다이의 저장 용량이 큽니다. 그래서 Macronix International은 3D 낸드 플래시 메모리를 엣지(단말기)의 추론 시스템에서 DNN 가중치 메모리로 활용하는 방법을 고안했습니다. 추론에선 플래시 메모리의 읽기 액세스가 계속 발생합니다. 이 경우엔 특정 메모리 셀을 읽지 못하는 불량이 나는 게 문제입니다.

Macronix International은 SLC 방식으로 용량이 64Gbit인 3D 낸드 플래시 메모리를 개발해 연속 읽기 수명을 측정했습니다. 그 결과 10의 13제곱에 달하는 연속 읽기가 가능하다는 결론이 나왔습니다. 실제 사용에선 10년 동안 쓸 수 있는 수명입니다.

200억 기부했다가 240억 증여세 폭탄맞고 암투병으로 돌아가신 황필상씨

200억 기부했다가 240억 증여세 폭탄맞고 암투병으로 돌아가신 황필상씨